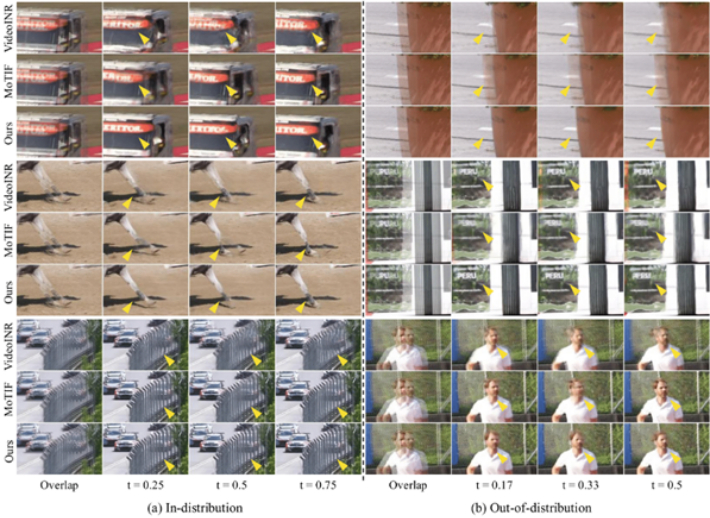

STVSR 기법들의 비디오 복원 결과. 개발된 AI 모델(각 시험 별 하단)이 기존 모델과 비교해 또렷하게 영상을 복원했다. 연구 그림 UNIST 제공

STVSR 기법들의 비디오 복원 결과. 개발된 AI 모델(각 시험 별 하단)이 기존 모델과 비교해 또렷하게 영상을 복원했다. 연구 그림 UNIST 제공흐릿하고 끊기는 영상을 또렷하고 매끄럽게 복원하는 인공지능 모델이 개발됐다.

UNIST(울산과학기술원) 인공지능대학원 유재준 교수팀은 영상의 해상도와 프레임을 동시에 개선하는 AI 모델 'BF-STVSR(Bidirectional Flow-based Spatio-Temporal Video Super-Resolution)'를 개발했다고 24일 밝혔다.

해상도와 프레임 수는 영상 품질을 결정짓는 요소다.

해상도가 높을수록 화면이 선명하고 디테일이 뚜렷해진다. 프레임 수가 많을수록 영상 속 움직임이 뚝뚝 끊기지 않고 매끄럽다.

기존 AI 영상 복원 기술은 해상도와 프레임을 따로 처리한다. 프레임 보강은 미리 학습된 옵티컬 플로우 예측 네트워크에 의존한다.

옵티컬 플로우는 사물 이동 방향과 속도를 계산해 중간 장면을 생성하는 방식이다. 연산이 복잡하고 오차가 쌓이기 쉬워 영상 복원 속도와 품질면에서 한계가 있다.

반면 'BF-STVSR'은 비디오 특성에 적합한 신호 처리 기법을 도입했다.

외부 옵티컬 플로우 예측 네트워크에 의존하지 않고 프레임 간의 양방향 움직임을 스스로 학습한다.

사진 왼쪽부터 유재준 교수, 김은진 연구원(제1저자), 김현진 연구원. UNIST 제공

사진 왼쪽부터 유재준 교수, 김은진 연구원(제1저자), 김현진 연구원. UNIST 제공이 흐름을 바탕으로 사물의 윤곽 등을 함께 추론함으로써 해상도와 프레임을 동시에 개선할 수 있다.

이 AI 모델을 저해상도·저프레임 영상에 적용한 결과, 기존 모델보다 PSNR, SSIM 등 품질 지표에서 더 우수한 성능을 기록했다.

PSNR과 SSIM 수치가 높다는 것은, 움직임이 많은 영상에서도 인물의 외형이 깨지거나 왜곡되지 않고 자연스럽게 복원됐다는 의미다.

유재준 교수는 "이번 기술은 저사양 장비로 촬영된 CCTV나 블랙박스 영상뿐 아니라 전송 용량을 줄이기 위해 압축된 스트리밍 영상도 빠르게 고품질로 복원할 수 있다"며 "미디어 콘텐츠 제작, 의료 영상 분석, VR 기술 분야에 전방위적으로 활용될 수 있을 것"이라고 설명했다.

이번 연구는 김은진 연구원이 제1저자로, 김현진 연구원이 공동 저자로 참여했다.

컴퓨터 비전 분야 권위 학회인 '2025 CVPR(Conference on Computer Vision and Pattern Recognition)'에 채택됐다.

2025 CVPR은 지난 11일부터 15일까지 미국 내슈빌에서 열렸으며, 전 세계에서 1만3천8편의 논문이 제출돼 이 중 22.1%인 2878편만이 채택됐다.